Wie vor einiger Zeit nebenbei erwähnt hat mir die WordPress-Statistik vor Augen geführt, dass mein Blog weniger gelesen wird als gedacht. Mein altes CMS hat für jeden Beitrag die Views, also Anzahl Aufrufe gezählt. Nur ist die diese Zahl leider nicht sonderlich aussagekräftig. Nicht jeder Aufruf stammt von einem interessierten Leser. Ganz im Gegenteil.

Was mir theoretisch klar war, haben mir diese Zahlen deutlich ins Bewusstsein gerufen: Ein grosser Teil des Internetverkehrs stammt nicht von Menschen, sondern von Bots. The Internet Is Mostly Bots, hat «The Atlantic» neulich geschrieben. Der Bot Traffic Report gibt an, dass 48,2 Prozent menschliche Nutzer sind. 22,9 Prozent seien gute Bots und 28,9 Prozent böse Bots.

Gute Bots, böse Bots

Etwas fällt bei dieser Studie sofort auf: nämlich die Unterscheidung in gute und böse Bots. Die guten überwachen die Website, holen legitimerweise Daten, erstellen Indizes für Suchmaschinen wie Google und Bing oder halten Feed-Verzeichnisse und andere Dinge am Laufen. Die bösen Bots versuchen Sicherheitslücken zu finden und in die Website einzubrechen, Spam-Kommentare abzusetzen, Daten zu stehlen, Viren zu infiltrieren oder Informationen abzuziehen.

Viele der Bots haben mit Suchmaschinenoptimierung (search engine optimization, SEO) zu tun – und da kann man sich streiten, ob das nun gut oder böse ist. Ich tendiere eher zum letzteren.

Natürlich ist der prozentuale Anteil nicht für jede Website gleich. Bei Websites, die viele Leute von sich aus besuchen, wird der Anteil der Bots im Vergleich geringer. Websites, die wenig Interesse hervorrufen, werden hingegen fast nur von Bots besucht. Denn die Bots sind nicht wählerisch: Die dringen auch ins Niemandsland vor, in der Hoffnung, dass sich da irgend etwas Interessantes finden lässt. Die menschlichen Besucher dagegen sind doch eher Herdentiere, die den ausgetrampelten Pfaden folgen.

Lassen sich Bots von Menschen unterscheiden?

Spätestens jetzt stellt sich die Frage, wie gut sich Bots und Crawler überhaupt von menschlichen Besuchern unterscheiden lassen. Ein «anständiger» Bot wird sich mit einer ehrlichen User Agent-Angabe ausweisen. Ein Bot mit fragwürdigen Absichten gibt sich wahrscheinlich nicht als Bösewicht aus. Die User-Agent-Angabe lässt sich natürlich beliebig ändern, wie seinerzeit hier beschrieben. Will man eine Volkszählung im Bereich der Webbots abhalten, kommt man nicht darum herum, Methoden zur Enttarnung zu entwickeln.

Ich nehme an, dass er sich in seinem Verhalten stark von einem menschlichen Besucher unterscheiden wird. Aber wie im Beitrag Ungewöhnlicher Datenverkehr beschrieben, hat mich Google schon mehrfach für einen Roboter gehalten und zum Ausfüllen von Captchas genötigt. Und wenn mich Google schon für einen Bot hält, dann wird es einem echten Bot womöglich gelingen, sich als menschlicher Surfer auszugeben. Ich könnte mir vorstellen, dass die Dunkelziffer noch deutlich höher ist.

Für die Bot-Analyse müsste man zahlen

Zurück zu meiner Website: Wie gross die Bot-Quote bei mir ist, kann ich nicht genau sagen. Es gibt bei Hostpoint ein Statistikmodul von Logaholic und das hält das Modul All Traffic by type bereit. Doch das ist nur für Pro-Nutzer zugänglich. Tja, Pech gehabt.

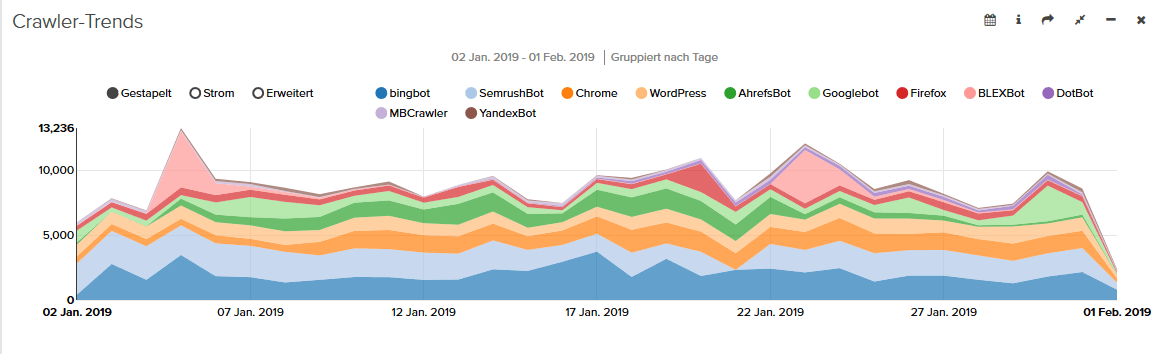

Immerhin, die beiden Module Crawler-Trends und Aktivste Crawler stehen auch mir Freeloader zur Verfügung. Und da ist beeindruckendes zu sehen: An crawlerreichen Tagen gibt es 12’000 und mehr Besuche von Bots – und das ist (leider) tatsächlich ein Vielfaches vom menschlichen Besuchsaufkommen. Verblüffend ist auch, was die Bots an Daten abziehen. Das sind leicht ein halbes oder auch mal ein oder zwei Gigabytes. Ich frage mich, wie das geht, wo meine ganze Website vielleicht ein halbes Gigabyte gross ist.

«Guten Tag, ihr lieben Bots…»

Beeindruckend auch die Parade der Bots, die in der Statistik ausgewiesen wird. Ich erlaube mir, sie hier einmal alle persönlich zu begrüssen: Hallo, schön, dass ihr vorbeischaut!

Das ist die Top-Ten der Bots in meinem Blog, mit einer kurzen Erklärung, so weit möglich:

- Bingbot: Klar, von der Suchmaschine Bing.

- SemrushBot: Der ist besonders datenhungrig. Er erzeugt Backlinks, die man dann aber selbst als Betreiber der besuchten Website nicht kostenlos ansehen darf.

- Chrome: ? (Infrage käme ein Bot wie Estyle.)

- Firefox: ? (Es könnte sich zum Beispiel um Indeedbot handelt, von dem man nichts Genaues weiss.)

- WordPress: Wohl die Anbindung von WordPress.com ans CMS.

- AhrefsBot: Ein Bot, der eine Datenbank mit angeblich 12 Billionen Einträgen füttert. Das Ziel ist, Marketing-Leute mit Informationen zu versorgen.

- Googlebot: Natürlich der Crawler für Googles Suchmaschine.

- Blexbot: Er füttert das Webmeup-SEO-Tool mit Daten.

- Dotbot: Noch so ein SEO-Ding, dieses Mal von moz.com.

- MBCrawler: Hier geht es, wen wundert es?, um SEO. Offenbar von monitorbacklinks.com.

- Yandexbot: Er gehört zur russischen Suchmaschine Yandex.

Gute Quellen für die Recherche sind übrigens webrobots.de und theinternetofbots.com.

Wenn ich einmal Zeit habe, werde ich unliebsame Bots aussperren

Fazit: Natürlich hätte ich mehr echte Besucher, und der ganze SEO-Quatsch geht mir gegen den Strich. Wenn ich Zeit hätte, würde ich ein paar der SEO-Bots blockieren. Aber da mir momentan selten langweilig ist, lasse ich sie halt gewähren.

Bleibt die Frage: Wird es schlimmer? Die Zahlen stammen von 2016. Eine neuere Statistik habe ich nicht gefunden; auch dieser scheinbar recht aktuelle Artikel hier bezieht sich auf diese Analyse. Die Untersuchung des Cloud-Anbieters Imperva Incapsula hat auch die Veränderungen über die Zeit untersucht.

Nach der schwankt die Verteilung: Der Anteil der menschlichen Besucher war 2013 auf einem Tief von unter 40 Prozent, dann stieg er wieder an. Das könnte auch nach 2016 so weitergegangen sein. Oder auch nicht: Hier steht, dass mit viel Risikokapital immer neue Bots in die Welt gesetzt werden. Wir werden sehen, wohin das führt.

Beitragsbild: So bohren sie sich durchs Internet und eine Homepage nach der nächsten… (Lars Nissen Photoart/Pixabay, CC0)