Seit einiger Zeit habe ich ein iPhone 11 als Leihgerät zur Verfügung. Wie hier in einem ersten Augenschein beschrieben, hatte ich anfänglich gewisse Mühe mit Face ID. Doch die ist überwunden – inzwischen habe ich mich tatsächlich daran gewöhnt, dass man auch als Kurzsichtiger das Telefon problemlos verwenden kann. Man sollte es einfach nicht direkt vor die Nase halten, wenn man entsperren will, während man die Brille nicht auf der Nase hat.

Natürlich stellt sich irgendwann die Frage, ob man mit dem TrueDepth-Sensor für die Gesichtserkennung noch andere Dinge treiben kann als nur Gesichtserkennung. Es handelt sich schliesslich um einen Sensor, der ganz ähnlich wie die Kinect-Leiste der Xbox funktioniert. Nicht ganz zufällig: Das israelische Unternehmen Primesense, das Kinect für Microsoft entwickelt hat, wurde im November 2013 von Apple gekauft.

Eine kleine Fehlprognose meinerseits (und von Microsoft)

Das dürfte mit ein Grund gewesen sein, weswegen Microsoft Kinect im Oktober 2017 eingestellt hat. Darum: Kurze Schweigeminute für die Technologie, deretwegen ich am 30. August 2010 im «Tagesanzeiger» behauptet hatte, der «Gamecontroller gehöre demnächst zum Alteisen»:

Nun [nach der Wiimote] geht Microsoft noch einen Schritt weiter und schafft den Controller komplett ab. Der Spieler steuert die Konsole mit freien Händen, dafür mit umso mehr Körpereinsatz.

Da haben sowohl Microsoft als auch ich die Trägheit der Nutzerschaft unterschätzt, die lieber auf dem Sofa sitzt, statt sich vor dem Fernseher abzumühen. Immerhin – gewisse Vorbehalte waren damals zu erkennen:

Die körperbetonte Spielweise ist schweisstreibend, und man ist wie bei der Wii gefährdet, sich durch wildes Herumhampeln vor dem Bildschirm und Hantieren mit unsichtbaren Objekten vor Zuschauern lächerlich zu machen. Die vielseitige und differenzierte Interaktion mit der Spielfigur schlägt indes alles bisher Dagewesene.

Bei manchen Spielern dürfte es ein metaphysisches Gruseln auslösen, den eigenen Avatar als eine Art Marionette seiner selbst in einer Spielewelt wiederzufinden. Trotzdem ist Kinect kein Holodeck wie in der Science-Fiction-Serie «Star Trek», das einen in die perfekte Simulation einer Schweinwelt versetzt. Kinect verlangt dem Spieler ab, sich ans Spiel-Szenario zu adaptieren und sich erwartungsgemäss zu bewegen.

Jetzt also verrichtet der Sensor in geschrumpfter Form unauffällig seinen Dienst. Es gibt aber Apps, mit denen man ihn direkt benutzen kann.

Zum Beispiel mit Heges 3D Scanner. Die App verwandelt die TrueDepth-Kamera in einen 3D-Scanner. Mit dem erzeugt man aus realen Modellen 3D-Objekte. Man kann angeblich alles scannen: «Kopf, Körper, dein Auto, Teile für den 3-D-Druck – was dir halt so einfällt.» Das deutet an, dass die Scans so gut sein sollen, dass man sie mittels 3D-Drucker wieder in richtige Gegenstände verwandeln kann. Ob das Drucken wirklich klappt, habe ich bislang aber nicht ausprobiert.

Das Scannen ist schwierig

Jedenfalls klingt die Beschreibung eindrücklich. In der Praxis zeigt sich schnell, dass das Scannen gar nicht so einfach ist. Da die TrueDepth-Kamera zur Erkennung des Benutzers gedacht ist, sitzt sie zusammen mit dem Display auf der Vorderseite.

Das ist höchst unpraktisch, wenn man nicht sich selbst, sondern irgend einen Gegenstand scannen will: Man muss irgendwie aufs Display schielen, um zu sehe, ob er noch schön zentriert ist, während man das Telefon bewegt. Als Trick kann man die Bildschirmsynchronisierung einschalten und das Kamerabild auf einem anderen Gerät kontrollieren.

Jedenfalls ist mir nicht auf Anhieb ein guter Scan gelungen. Man muss erstens die richtigen Einstellungen treffen; insbesondere die passende Genauigkeit (precision). Diese Einstellung hat Auswirkungen darauf, wie weit weg das Objekt maximal sein kann, damit es noch erfasst wird. Dieser maximale Abstand sollte umgekehrt auch nicht zu gross sein, damit nicht Gegenstände im Raum mitdigitalisiert werden, die einen gar nicht interessieren.

Ich fand es am einfachsten, den Modus Range zu verwenden und den Schieber unterhalb des Live-Bildes links zu positionieren. So gerät nur ein relativ überschaubarer Bereich ins Visier der App.

Gut wirds nur mit viel Sorgfalt

Des Weiteren muss man sich darauf konzentrieren, sein Objekt langsam und sorgfältig abzutasten. In der Anleitung steht es wie folgt:

Move your iPhone/iPad slowly while scanning. If the scan quality isn’t sufficient, try moving even slower — try playing with it to see how slow/fast movement influences quality (try also moving very slowly — e.g. at 5mm per second).

Man muss das Telefon demnach mit etwa fünf Millimetern pro Sekunde bewegen. Das zu scannende Objekt selbst darf sich überhaupt nicht bewegen.

Das hat zur Folge, dass es schwierig ist, sich selbst oder seinen Kopf in ein 3D-Objekt zu verwandeln. Wenn man das tun will, braucht man jemanden, der das Scannen vornimmt, während man sich einzig darauf konzentriert, den Kopf nicht zu bewegen.

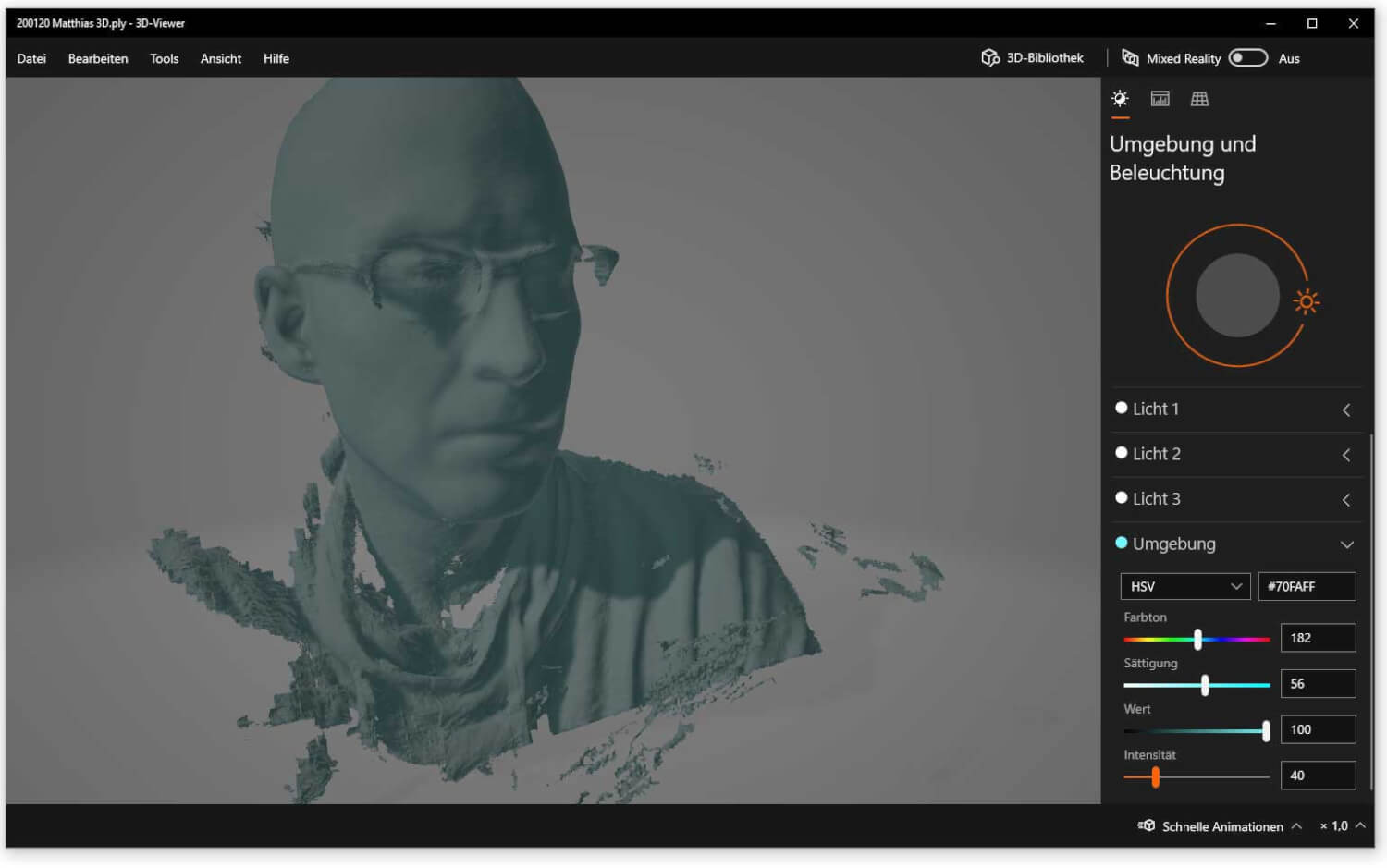

Mein Kopf in 3D

Ich habe es trotzdem probiert und mich an einem 3D-Selfie versucht. Nach ein paar verunglückten Scans war das Ergebnis beeindruckend – auch wenn man für ein perfektes Ergebnis noch genauer hätte arbeiten müssen.

Nach dem Scannen findet man sein Modell in der Library. Dort erzeugt man über den Befehl Export Model to PLY (with colors) ein farbiges Modell im Polygon File Format. Das liesse sich auch einem 3D-Drucker vorwerfen – und in Windows 10 wird es ohne weitere Umstände per Doppelklick in der 3D Viewer-App geöffnet. Es erscheint zwar farblos. Aber man kann das Objekt drehen und auch die Lichtquellen verändern – was schon recht eindrücklich ist, wenn man seinen eigenen Kopf einmal von allen Seiten betrachten möchte.

Alternativ hat man, via Export Model to STL (without colors) auch das farblose STL-Format zur Verfügung, das anscheinend vor allem in der CAD-Welt Verwerwendung findet.

Fazit: Das ist ziemlich nerdig – aber auch ziemlich faszinierend. Und auch wenn das Scannen geübt sein will, erzielt man ohne jegliche Zusatzhardware mit etwas Geduld erstaunlich gute Resultate. Das ist erstaunlich!

Wer scannen will, muss zahlen…

Die App ist kostenlos, doch für die Scanfunktion muss man als In-App-Kauf neun Franken bezahlen. Das klingt nach Irreführung, doch der App-Entwickler hat eine gute Erklärung dafür: Es sei nicht möglich, die App nur für iPhone-Modelle mit TrueDepth-Kamera anzubieten. Und das ist ein einleuchtender Grund: Müsste man die App direkt beim Kauf bezahlen, würden Leute sie kaufen, die sie nicht nutzen können – und das wäre mehr als ärgerlich. Der In-App-Kauf hingegen wird nur den Nutzern angeboten, die ein passendes Gerät haben.

Schneller und einfacher klappen die Scans übrigens mit der App Scandy Pro (kostenlos fürs iPhone). Die Qualität hat mich bei dieser App nicht so ganz überzeugt, weswegen ich für ernsthafte Versuche Heges 3D Scanner empfehlen würde.

Eine weitere App, die ich nicht ausprobiert habe, ist Capture: 3D Scan Anything. Die gibt es kostenlos.

Beitragsbild: Nein, das ist nicht mein Kopf, der mit einem 3D-Drucker ausgedruckt wurde. Und mutmasslich wurde dieses Objekt hier auch nicht mit einem iPhone digitalisiert (Neonbrand/Unsplash, Unsplash-Lizenz).

https://www.trnio.com funktioniert sagenhaft gut!

Das habe ich auch mal vorgestellt: Wie meine Eule in den Cyberspace kam